机器之心编辑部

在 iPhone 上跑 Gemma 4,相信很多人都尝试过了。从大家的反馈来看,模型的可玩性还是很强的,聊一些简单问题也很流畅,只是在上下文变长、开启深度思考时速度会变慢,而且会有手机发烫、耗电飞快等问题(详细反馈参见这篇文章的评论区:《iPhone 本地跑 Gemma 4 火了,0 token 时代还有多远?》)。

此外,最近还有不少人在研究另一种玩法:在电脑上运行 Gemma 4 并将其与龙虾(OpenClaw)连接

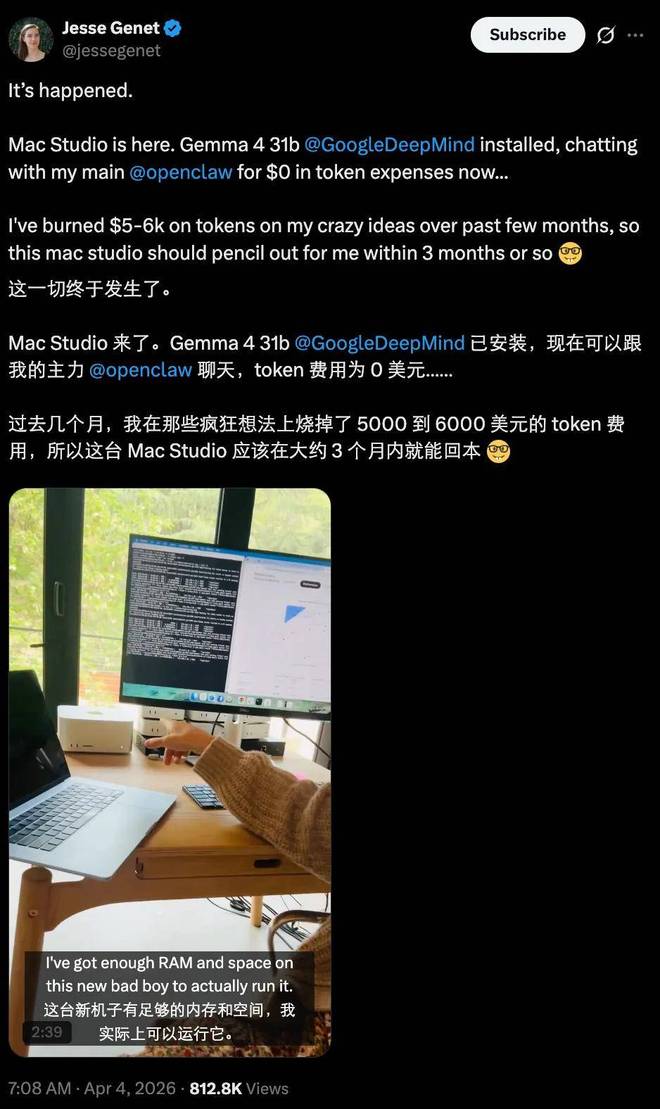

一开始,大家只是自己小范围尝试,比如有一个博主说自己在 Mac Studio 上安装了 Gemma 4 31B 版本,并声称由于这种本地部署不花 token 费用,这台 Mac Studio 3 个月就能回本。当然,这种说法是否站得住脚,还得看模型性能是否真的那么能打。

今天,谷歌 Gemma 官方也下场了,直接教大家如何分三步把 Gamma 4 和龙虾连上。

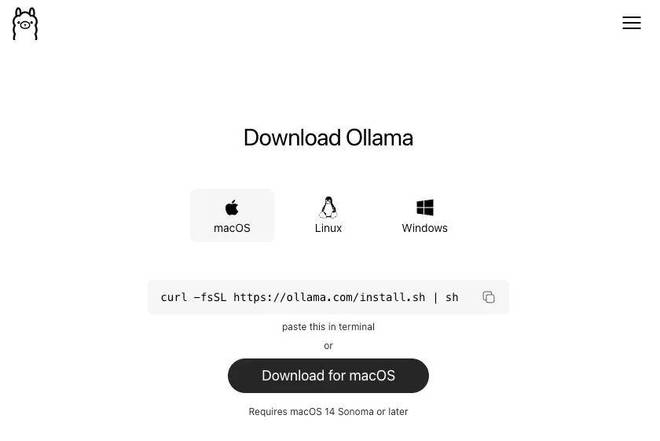

做法其实很简单。第一步:下载安装 ollama:https://ollama.com/download

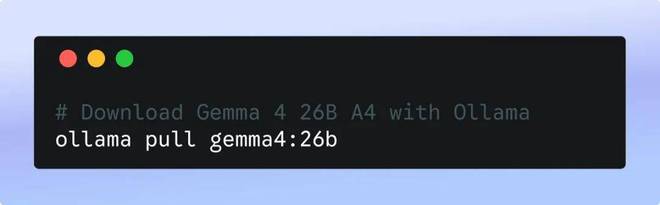

第二步:将 Gemma 4 的合适版本(官方推荐的是 26B A4B)下载到你的机器上。你也可以跳过此步骤,因为步骤 3 会处理所有事项。

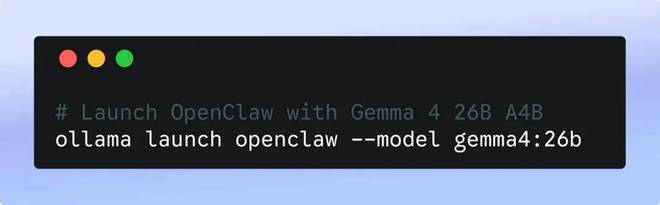

第三步:通过 Ollama 以 Gemma 4 为后端启动 OpenClaw。这将自动在你的系统上安装 OpenClaw 并使用 Gemma 4 26B A4B 启动它。

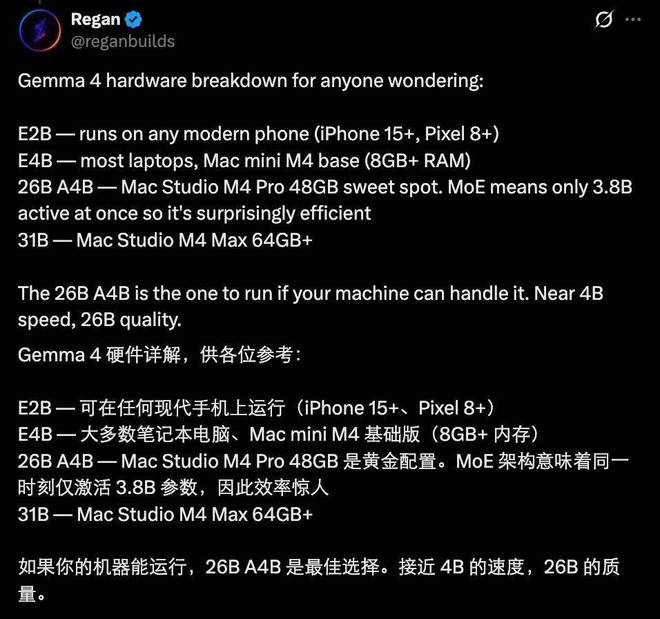

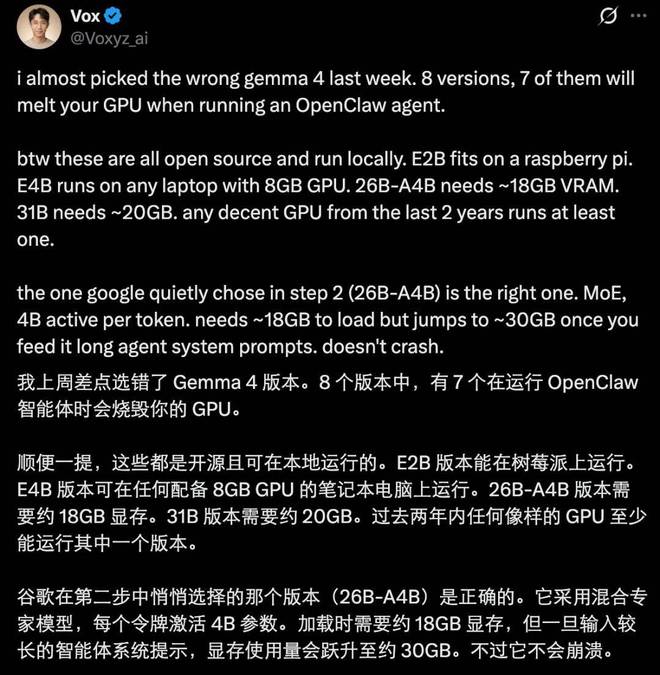

当然,具体选哪个版本的 Gemma 4,还要看你电脑的配置情况,有人给出了以下参考建议,看来,要想运行官方推荐的 26B A4B 版本,你得买一台 Mac Studio M4 Pro 48GB 或与之相当的机器。

至于显存,不同的机器要求也不一样,如果是 Mac Studio M4 Pro 48GB,16GB 可能就够用了。如果是配置 GPU 的笔记本电脑,显存可能至少要达到 18GB。

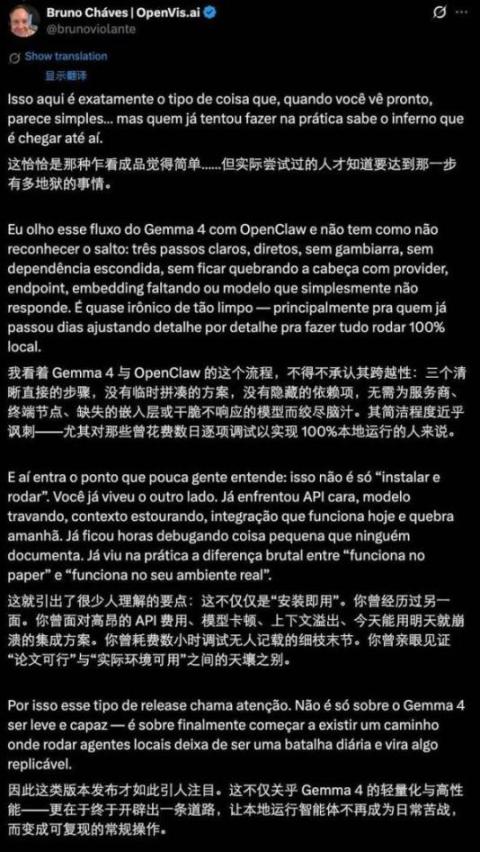

看了谷歌官方给的这个教程,有人感慨地说:Gemma 4 + OpenClaw 的整个流程超级干净,就三步,清晰直接,没有任何弯弯绕绕、隐藏依赖、provider 配置、endpoint 调不通、embedding 缺失、模型不响应这些破事。以前做本地 Agent 的人,经常要花好几天调各种细节、debug 文档里根本不写的坑、面对 API 贵、模型卡死、上下文爆炸、今天能跑明天就崩的问题。所以这次发布真正厉害的不是模型本身「轻量又强」,而是终于把「本地跑 Agent」从一场每天都在打的苦战,变成了真正可复制、简单可用的东西。

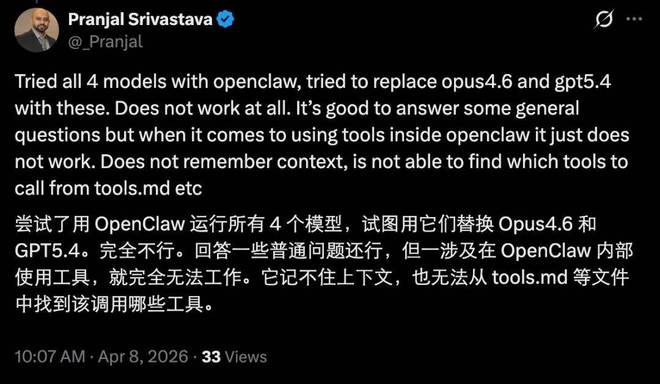

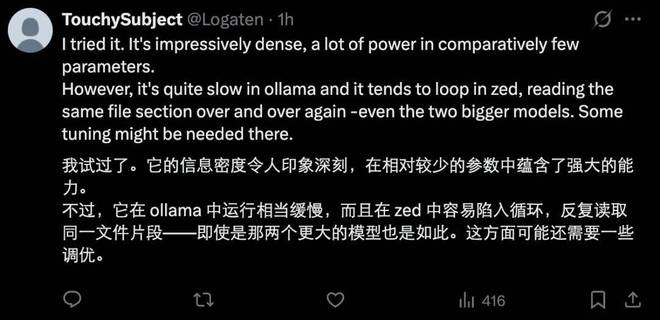

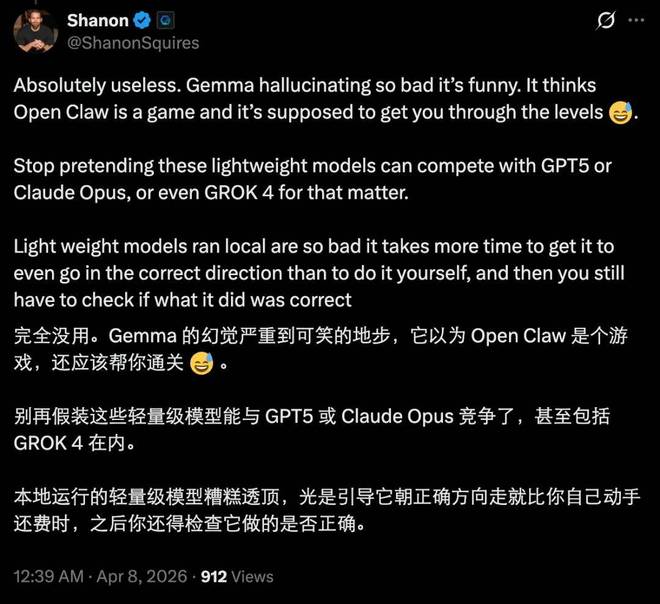

那跑起来效果怎么样呢?从反馈来看,即使是最大版本的 Gemma 4,智力水平上和 Opus 等顶尖模型肯定还是差一大截,而且在调用工具、长上下文等方面短板明显。这让很多人质疑本地部署这一模型的实用性。

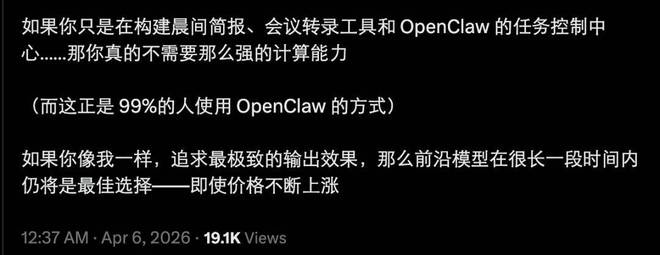

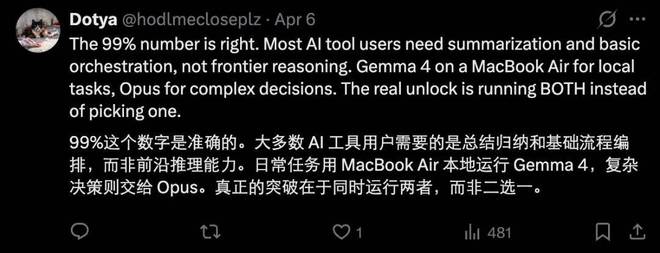

但也有人指出,其实很多人用龙虾处理的任务都相当简单,比如做简报、会议转录和一些定时任务,这类任务让本地模型去跑还是很实用、很划算的。

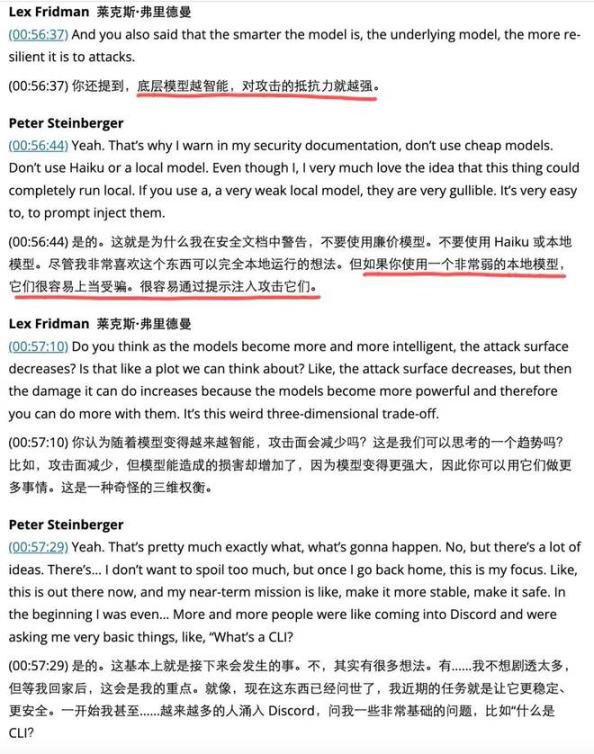

此外,还有一个值得关注的问题,在 OpenClaw 里用小模型到底安不安全?

龙虾之父 Peter Steinberger 曾在采访中说,他奉劝大家不要用廉价的小模型或本地模型,因为这类模型很容易受到提示注入攻击,更加智能的模型在一定程度上更容易识别出这种攻击。

所以,这种部署方式到底要不要尝试,大家还得自己掂量一下。